Чип или погибни: как OpenAI спасает себя от дефицита и диктует новое будущее ИИ

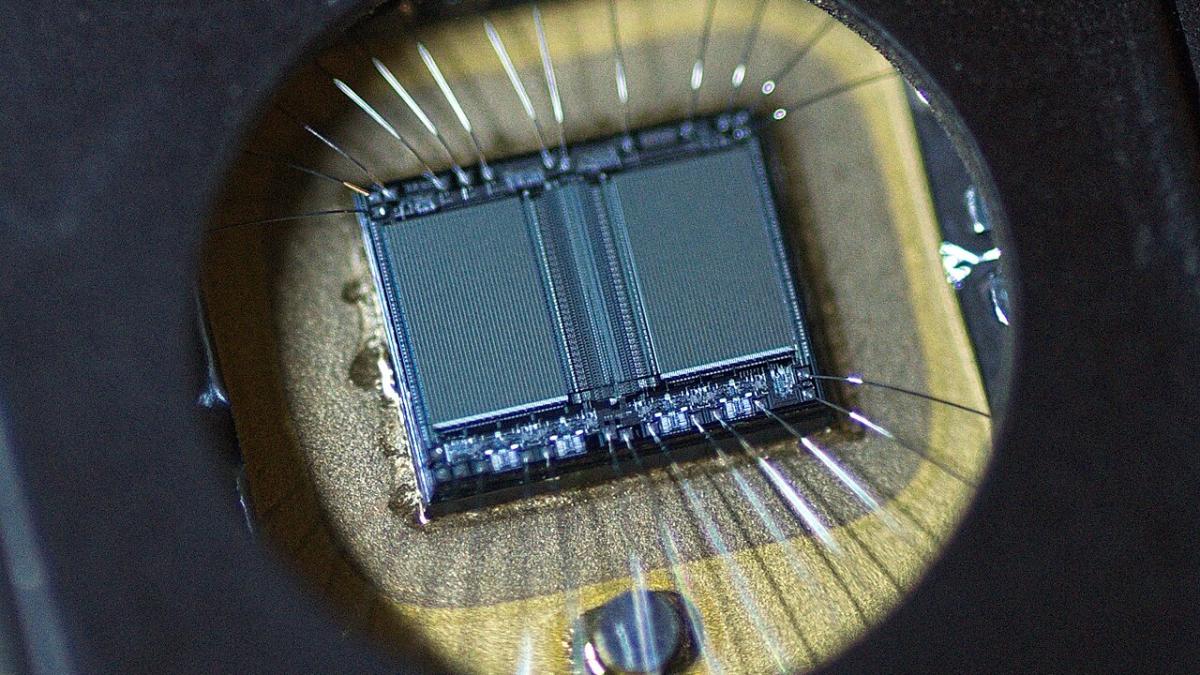

Компания OpenAI объявила о стратегическом партнёрстве с Broadcom, направленном на разработку и производство собственных специализированных чипов для искусственного интеллекта. Это решение призвано снизить зависимость от Nvidia и обеспечить OpenAI устойчивую вычислительную базу для масштабирования своих продуктов — от ChatGPT и Sora до будущих систем искусственного сверхинтеллекта.

Почему OpenAI создаёт свои чипы

Бурный рост интереса к AI-продуктам требует колоссальных вычислительных мощностей. Традиционные графические процессоры Nvidia, которые доминируют на рынке, становятся всё труднее достать, а их стоимость постоянно растёт. Создание собственных микросхем — логичный шаг, позволяющий OpenAI контролировать производственные цепочки и оптимизировать энергоэффективность под собственные задачи.

Новая инициатива направлена на то, чтобы "встроить интеллект в железо" — объединить архитектуру моделей и аппаратное обеспечение в единую экосистему, что повысит производительность и снизит затраты.

"Это критически важный шаг в создании инфраструктуры, необходимой для раскрытия потенциала ИИ и обеспечения реальных преимуществ для людей и бизнеса", — заявил генеральный директор Сэм Альтман.

Подробности партнёрства

OpenAI планирует совместно с Broadcom разработать и внедрить 10 ГВт специализированных ИИ-ускорителей, которые станут ядром будущих дата-центров компании. Эти решения будут работать на основе Ethernet-инфраструктуры и сетевых технологий Broadcom, обеспечивая высокую пропускную способность и низкую задержку обмена данными.

Производственная фаза начнётся во второй половине 2026 года, а завершение проекта запланировано на конец 2029 года. Новые стойки серверов создадут основу для следующего поколения вычислений, необходимых для обучения и обслуживания масштабных AI-моделей.

Связанные соглашения: AMD, Nvidia и Microsoft

Партнёрство с Broadcom стало частью более широкой стратегии OpenAI по диверсификации поставщиков и источников вычислительных ресурсов.

Ранее компания подписала:

-

долгосрочный контракт с AMD на поставку GPU для дата-центров общей мощностью 6 ГВт;

-

соглашение с Nvidia о совместном развертывании инфраструктуры мощностью 10 ГВт, в которое Nvidia инвестирует около 100 млрд долларов.

Такое распределение мощностей позволит OpenAI снизить риск дефицита оборудования и обеспечить стабильное развитие продуктов, включая ChatGPT, DALL·E, Codex и Sora.

Изменение условий эксклюзивного соглашения с Microsoft также сыграло ключевую роль: теперь OpenAI может самостоятельно строить инфраструктуру и заключать новые партнёрства. Предполагается, что Microsoft сможет использовать будущие чипы OpenAI-Broadcom и в своих облачных сервисах Azure для обучения и развёртывания моделей.

Технологическая гонка за независимость

В последние годы ведущие IT-игроки стремятся к большей автономии в производстве аппаратного обеспечения.

| Компания | Собственные чипы | Назначение | Год запуска |

| TPU | Обучение нейросетей и сервисы облачного ИИ | 2016 | |

| Meta* | MTIA | Внутренние вычисления для AI-рекомендаций | 2023 |

| Apple | Neural Engine | Оптимизация нейросетей на устройствах | 2020 |

| Microsoft | Maia AI Accelerator | Центры обработки данных Azure | 2023 |

| OpenAI + Broadcom | ИИ-ускорители нового поколения | Обучение и развёртывание моделей OpenAI | 2026 |

Таким образом, OpenAI следует глобальной тенденции: крупные игроки стараются снизить зависимость от Nvidia, чтобы избежать дефицита GPU и высоких издержек. Особенно это важно в условиях растущего спроса на обучение моделей нового поколения.

Что даст OpenAI переход на собственные чипы

-

Скорость обучения. Оптимизация чипов под архитектуру GPT сократит время обучения моделей в несколько раз.

-

Энергоэффективность. Новые ускорители смогут потреблять меньше энергии на единицу вычислений.

-

Гибкость. OpenAI получит возможность самостоятельно масштабировать мощности и адаптировать инфраструктуру под задачи конкретных моделей.

-

Безопасность. Контроль за аппаратным уровнем позволит снизить риски утечек данных и повысить устойчивость систем.

-

Инновации. Интеграция "интеллекта в железо" создаёт платформу для будущих AI-систем, включая прототипы искусственного сверхинтеллекта.

Ошибка → Последствие → Альтернатива

-

Ошибка: полная зависимость от Nvidia.

Последствие: дефицит GPU и рост затрат.

Альтернатива: собственные ИИ-чипы и диверсификация поставок. -

Ошибка: использование стандартных дата-центров.

Последствие: низкая производительность при обучении крупных моделей.

Альтернатива: специализированные ускорители под архитектуру GPT. -

Ошибка: ограничение вычислений в облаках партнёров.

Последствие: отсутствие контроля над инфраструктурой.

Альтернатива: строительство собственных ЦОД с AI-инфраструктурой 10 ГВт.

А что если OpenAI достигнет полной автономии?

Если OpenAI сумеет развернуть 10 ГВт собственной вычислительной мощности, это станет крупнейшим прорывом в истории ИИ-инфраструктуры. Такой масштаб позволит компании обучать модели уровня AGI (искусственного общего интеллекта) без внешней зависимости и ускорит внедрение AI-технологий в экономику.

Кроме того, OpenAI сможет продавать вычислительные мощности другим компаниям, превратившись не только в разработчика, но и в поставщика облачных AI-сервисов нового поколения.

Плюсы и минусы собственного производства чипов

| Плюсы | Минусы |

| Независимость от поставщиков | Высокие затраты на R&D |

| Оптимизация под собственные задачи | Долгий цикл разработки |

| Энергоэффективность и масштабируемость | Технические риски на старте |

| Ускоренное обучение моделей | Требуется новая инженерная команда |

FAQ

Когда появятся первые чипы OpenAI-Broadcom?

Развёртывание оборудования начнётся во второй половине 2026 года.

Каков масштаб инфраструктуры?

Ожидается создание системы мощностью 10 ГВт — это сопоставимо с крупнейшими дата-центрами в мире.

Почему OpenAI всё ещё сотрудничает с Nvidia и AMD?

Компания диверсифицирует риски: собственные чипы не заменят полностью GPU, а будут дополнять существующую инфраструктуру.

Мифы и правда

Миф: OpenAI отказывается от Nvidia.

Правда: Nvidia остаётся ключевым партнёром, но OpenAI стремится к балансу и гибкости.

Миф: Broadcom займётся исключительно производством.

Правда: компания участвует в совместном проектировании и оптимизации сетевой архитектуры.

Миф: новые чипы будут использоваться только для ChatGPT.

Правда: они станут базой для всех продуктов OpenAI, включая Sora, DALL·E и будущие AI-модели.

Интересные факты

• 10 ГВт вычислительной мощности эквивалентны энергопотреблению небольшого города.

• Nvidia владеет более 80% рынка AI-чипов, что объясняет стратегию OpenAI по диверсификации.

• Broadcom ранее участвовала в разработке сетевых решений для дата-центров Google и Amazon.

Исторический контекст

-

2016: Google выпускает первые TPU для нейросетей.

-

2020: Microsoft начинает проект Maia AI Accelerator.

-

2023: OpenAI подписывает соглашение с Nvidia и AMD.

-

2025: объявлено партнёрство с Broadcom.

-

2026: старт развертывания собственных AI-ускорителей.

Подписывайтесь на NewsInfo.Ru